言葉や動作などにより人間とコミュニケーションを取ることを目的に開発されたロボットが注目されています。

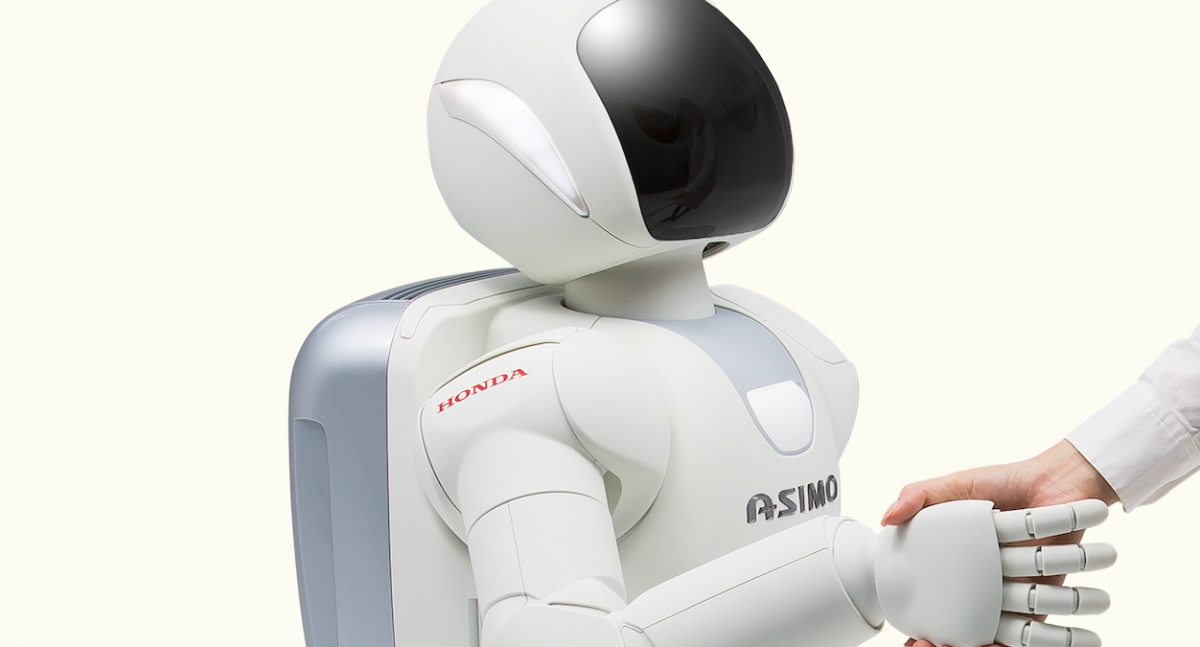

ソフトバンクのPepperくん、あるいは本田技研工業のASIMOくんの映像をWebやテレビなどでご覧になった方も多いかもしれません。

私たちがロボットに期待するのは、やはり会話力ですよね。

私たちと同じような姿・カタチをした「しゃべるロボット」に対しては、ものすごく親しみを感じてしまうもので、店頭でPepperくんを見つけると思わず話しかけてみたくなった方も多いでしょう。

ところで、現在のしゃべるロボットの会話の実力はどの程度のもので、はたして私たちの話し相手になれるのか、とても気になるはず。

ということで、今回はしゃべるロボットの例と会話を実現する仕組み、さらには今後のしゃべるロボットに求められる能力について、一緒に考えてみましょう。

それでは最初に、人気のしゃべるロボットについて見てゆきます。

人形やぬいぐるみタイプのしゃべるロボットが人気!

ここでは、しゃべるロボットの例として3台ご紹介します。

世界初の量産ヒト型ロボット「Pepper」(ソフトバンク)

2014年にソフトバンクが発表・販売した、世界で初めて量産されたヒト型ロボットが「Pepper」です。

携帯ショップの店頭や、様々なイベントの受付で見かけた方も多いでしょう。

本体価格と3年間の維持費の合計が百万円を超えることから、個人使用というよりも企業がビジネスシーンで活用する場合が多いのが特徴です。

発表直後は大変なブームとなりましたが、ヒトのカタチをしていることから、その会話力が過剰に期待されてしまったこともあり、3年後のレンタル契約更新をしている企業は少数派(2割未満)という残念な結果となりました。

孫のように癒やされる「もっとなかよしRobi Jr.」(タカラトミー)

タカラトミーが販売する「もっとなかよしRobi Jr.」は歩行機能をあえてカットし、会話機能を楽しむことを目指したロボットです。

価格は15,000円と手軽に購入できるコンパクト(身長20cm)なロボットで、かわいらしいデザインと声(ピカチュウの声優さんが担当)が魅力で子供や高齢者の話し相手として人気があります。

ただし、人間の声の方向を感知して顔を向けて手足を動かしながら「ただいま」「おかえり」程度の会話は可能ですが、認識できる言葉はわずか40語程度と非常に少なく、残念ながら人間との会話のキャッチボールまでは対応していません。

歌って踊れる「Palmi」(DMM.com)

DMM.comが販売する「Palmi」は二足歩行が可能なロボットで、価格は約30万円とちょっと高めですが、顔や声紋によるユーザー識別機能、歌いながら踊る機能、インターネットより入手したニュース・天気情報の説明、クイズ、占い、落語などの様々な楽しい機能を持っています。

Palmiが話してくれる内容は非常に物知りでおもしろいのですが、Palmiが認識しやすいキーワード以外の認識がイマイチ、話している途中で声をかけてもなかなかこちらの話を聞いてくれないなど、まだまだ人間との自然な会話までは実現できていません。

しゃべるロボットは今回ご紹介した「もっとなかよしRobi Jr.」のように、その愛らしい仕草により、孫のように癒やされることから、人形やぬいぐるみタイプのロボットの方が、一人暮らしのお年寄りに人気があります。

意外なことに会話能力はそれほど重要視されていないようで、かわいい仕草でそれなり?に応答してくれれば、それで充分ということですね…。

実は会話能力については、既にスマートスピーカー(Google Home、Amazon echoなど)やスマホアプリ(Googleアシスタント、Amazon Alexaなど)の方が、しゃべるロボットよりも技術的にかなり先行しており、「Pepperでなくてもスマホアプリで充分」と思われてしまったことがレンタル契約更新減少の原因の一つにもなっています。

それでは次に、しゃべるロボットがどのような仕組みで会話を実現しているのか確認しましょう。

しゃべるロボットが会話を実現する仕組み

しゃべるロボットは人間との会話において「音声認識」「応答生成」「音声合成」の3つの処理を行っています。以下、それぞれについて簡単にご紹介します。

音声認識:人間の音声会話をテキストに変換

- 音声データの一音一音を音素(音声の最小単位)に分解します。

(例:「おはよう」という音声データより”o” “h” “a” “y” “o” “u”という音素に分解) - 音素の並びと辞書とのパターンマッチングを行い、音素の並びから単語に変換します。

(例:”o” “h” “a” “y” “o” “u”[音素] ⇒ “おはよう”[テキストの単語]) - 変換してできた複数の単語より、単語のつながり(ある単語Aの次に単語Bが出現する確率など)を考慮しながら、最も可能性が高い組み合わせとして文章を作成します。

以上のように「音声」⇒「音素」⇒「単語」⇒「文章」というステップにより人間の音声会話をテキストに変換してゆきます。

(参考)近年では「音声」⇒「音素」および「単語」⇒「文章」の変換処理へディープラーニングを適用することにより、音声認識精度を大きく改善できています。

しかしながら、雑音が多い環境、くだけた表現、明瞭でない発音の場合には、まだまだ人間の認識精度の方が上回っています。

(参考)ディープラーニングについてはこちら

応答生成:どう答えるべきか「答え」の文章を選定

テキストに変換された人間の会話と、SNSなどから収集した膨大な会話データとを比較(単純比較あるいは文章としての距離を計算、など)したうえで、最も適切と思われる文章を「答え」として選定します。

ただし、ここでご注意いただきたいのは、テキストに変換された人間の会話と関連性の高い文章を返しているだけであって、人間の会話の意味については「全く理解していない」という点です。

(参考)近年では今回ご紹介した、実際の会話データとの比較から答えの文章を選定する手法(Retrieval model)だけでなく、ディープラーニングを使用して答えの文章を自動生成する手法(Generative model:ある単語の次に来る単語を、膨大な文章例より予測して単語をつなぎ合わせてゆく)が注目を集めています。

ただし、この技術でも文章の意味は全く理解できておらず、意味を理解できていない「単語」の並びを予測しているだけです。

ちなみにGenerative modelは日本マイクロソフトが提供する会話ボット「りんな」でも採用されています。

(参考)ボットについてはこちら

音声合成:答えるべきテキストを音声に変換

作成した「答え」のテキストデータを音声ファイルに変換します。

(参考)近年、ディープラーニングによりスマートスピーカーの音声合成技術は大幅な進化を遂げました。

私たちが、ある文章を全く同じように複数回読み上げても、それぞれの波形は全く同じではなく、音の強弱や間のとり方などに微妙な差(ゆらぎ)が発生します。

実はこの「ゆらぎ」が人間らしさを感じさせてくれるもので(ゆらぎがないと機械っぽく聞こえる)、今までの音声合成技術ではゆらぎを再現するのは非常に難しいことでした。

ところが、あのアルファ碁を開発したDeep Mind社が開発した音声合成技術「WaveNet」は、ディープラーニングにより、精度良くゆらぎを表現した自然な音声合成を実現、現在のスマートスピーカーやスマホアプリに活用されています。

(参考)アルファ碁についてはこちら

さて、しゃべるロボットがどのような仕組みで会話を実現しているのか見てきましたが、「音声認識」「応答生成」「音声合成」いずれの技術も今後、ディープラーニングによりさらなる進化が期待できるかもしれません。

とはいうものの、やっぱり不満に感じてしまうのは「応答生成」ではないでしょうか。会話をしているというのに(ロボットだけでなく、スマートスピーカーもスマホアプリも同じく)意味を全く理解していない、なんて納得できません。

これでは会話しているとは言えないので、言葉の意味を理解できない限り、ロボットは私たちの話し相手にはなれませんよね。

確かに現時点では言葉の意味理解については、残念ながら解決のメドがたっていない状況ですが、私たちの話し相手になるためには、言葉の意味理解以外にも、いくつか必要となる能力があります。

そこで次に、言葉の意味理解以外に必要となる能力3点について一緒に考えてみましょう。普段、私たちは何気なくおしゃべりしていますが、実は非常に高度な処理を無意識に行っているんです。

今後必要となる能力その1:相手の表情やしぐさから気持ちを読み取る

私たちが対面会話する場合、相手から受け取る情報としては言語情報(文字情報)よりも、非言語情報(顔の表情、声の強弱、ジェスチャーなど)の方が多いことが分かっており、会話において非言語情報の解析能力は欠かすことのできない能力なんです。

過去のテレビ番組で、マツコ・デラックスそっくりのロボット「マツコロイド」とマツコ・デラックス本人を対面させるという企画がありましたが、残念ながら両者の間での会話はうまく進みませんでした。

これはマツコ本人が夫婦についての話題から離れたがっているのに、会話に夫婦の話題が出てきたことから、マツコロイドが夫婦に関する話題を振り続けてしまったのが原因です。

マツコロイドは会話における文字情報の分析のみで判断してしまい、マツコ本人の表情やしぐさから気持ちを読み取ることができませんでした。

ただし、このマツコロイドの鈍感さが番組スタッフや視聴者にはウケて笑いを取ることができたので、番組的には成功だったようです。

私たちは相手の表情やしぐさを観察し、相手の考えを予測しながら会話を進める、という作業を瞬時に、しかも無意識に行っています。

膨大な量の会話のケース(可能性)について力まかせにゴリゴリ計算して最適解を選ぶ、というAI(人工知能)の手法は、人間のやり方とはちょっと違うかもしれません。

今後必要となる能力その2:雑談で互いの理解を深める

私たちの日常会話において雑談の占める割合は実に6割以上を占めており、全てのコミュニケーションは雑談から始まる、とも言われています。

私たちは雑談により、他人とつながるための最初のきっかけ作りを行い、雑談を重ねることによって共感し、理解を深めながら互いの信頼関係を築き上げてゆきますよね。

過去に行われたロボットと人間との会話実験では、人間がロボットに対して「今日の調子はどう?」などと雑談に持ち込み、相手がロボットだと分かっていても人間関係を作り出そうとすることが分かっています。

私たちは、会話により他人とつながることによって幸福感を感じる生き物であり、「雑談をしたい」という強い欲求を持っています。ロボットにとっても雑談力は欠かすことのできない能力なんです。

研究によると、人間による雑談のテーマは何千とあり、一番多いテーマでも全体に占める割合は1%にも満たないことが分かっています。

雑談における文脈(文章の流れ)は人それぞれで無限にあって、しかも(論理破綻していても)それぞれが間違いではないという、それこそ何でもあり、の正解のない世界です。

大量のデータを学習して正解を選ぶ現在のAI(人工知能)の手法では、人間相手の雑談はちょっと難しそうですね。

今後必要となる能力その3:会話における男女の役割の違いに対応できる

最後にご紹介するのが会話における男女の役割の違いです。以下は会話における女性の特徴例を示したもので、カッコ内は対する男性の特徴となります。

- 悩みを話し合いストレスを軽減したい(問題に対する解決策を考えてしまう)

女性が悩みについて話す場合、相手に求めるのは、とにかく話を聞いてもらい共感してほしいことにあります。

女性は解決策までは求めていない場合が多いのですが、男性は悩みを聞かされてしまうと、条件反射的に解決策を検討し始めてしまいます。 - 回りくどい言い方を好む(ストレートな言い方を好む)

女性は対立を避けて、相手と親しくなり良好な関係を築くため遠回しな言い方を好みますが、男性は要点をシンプル(身も蓋もないカタチ)に整理したがります。

なお、この女性の特徴はビジネスの現場においては、せっかくの良い提案が男性に理解されない、という残念なことになってしまう場合があります。

これらの違いは、長年の男女の役割の違い(男性:狩猟担当でコミュニケーション能力を身につける必要性があまりなかった、女性:子供を病気から守り育て家を守る役割があり、他人のわずかな気持ちや態度の変化に気づく必要があった)に加えて、脳の構造上の違いにも理由があります。

研究によると、脳の左半球と右半球をつないでいる「脳梁」(ケーブルのようなもの)は女性の方が太く、脳内における情報の連絡能力は1.3倍も女性の方が優れていることが分かっています。

左右の脳の間で素早く情報をやり取りできるため、目や耳より入力された情報を統合・解釈できる能力は、女性の方が男性よりも優れています。

女性同士であれば、相手の気持ちの変化をすぐに察知して会話を続けることができますが、男女間だと、女性が涙をこぼすまで、男性は何が起きているのか全く理解できていない、という残念な結果になってしまう場合もあります。

会話に関する男女の違いは、今までの長い歴史や脳の構造に原因があります。このため、私たち人間側で解決できるものではなく、ロボット側で対応する必要があります。

悩みについて共有したいのにロボットが解決策を語り始めた途端、女性はスイッチを切ってしまうでしょう。また、ロボットが遠回しな言い方を始めると男性は「で、何が言いたいんだ?」と叫んでしまうでしょう。

女性がロボットに求める要件、また男性がロボットに求める要件はそれぞれ異なるため、今後は女性と男性、それぞれに対応できるロボットが求められます。

男性研究者だけで開発したしゃべるロボットなんて、女性にとっては「お断り」ですよね。今後はAI(人工知能)研究への、より多くの女性研究者の参画が必要となるでしょう。

以上、今回はしゃべるロボットの例と会話を実現する仕組み、さらには今後のしゃべるロボットに求められる能力について、一緒に考えてみました。

- 人形やぬいぐるみタイプのしゃべるロボットが人気!

1)世界初の量産人型ロボット「Pepper」(ソフトバンク)

2)孫のように癒やされる「もっとなかよしRobi Jr.」(タカラトミー)

3)歌って踊れる「Palmi」(DMM.com) - しゃべるロボットが会話を実現する仕組み

1)音声認識:人間の音声会話をテキストに変換

2)応答生成:どう答えるべきか「答え」の文章を選定

3)音声合成:答えるべきテキストを音声に変換 - 今後必要となる能力その1:相手の表情やしぐさから気持ちを読み取る 私たちが対面会話する場合、相手から受け取る情報としては言語情報よりも、非言語情報の方が多いことが分かっており、会話において非言語情報の解析能力は欠かすことのできない能力です。

- 今後必要となる能力その2:雑談で互いの理解を深める

私たちの日常会話において雑談の占める割合は実に6割以上を占めています。

私たちは「雑談をしたい」という強い欲求を持っており、ロボットにとっても雑談力は欠かすことのできない能力です。 - 今後必要となる能力その3:会話における男女の役割の違いに対応できる

女性がロボットに求める要件、また男性がロボットに求める要件はそれぞれ大きく異なります。

今後は、女性あるいは男性、それぞれに対応できるロボットが求められます。

現在のAI(人工知能)が、言葉の意味を理解できない件については、残念ながら現時点では解決のメドが立っていません。

しかしながら、今後の遠い将来、AI(人工知能)の研究が進むことにより、言葉の意味を理解する仕組みや、雑談をしたいという欲求が生まれる仕組みなどについても、いずれは明らかになる日が来るでしょう。

また、ロボットに性別はないのでこれは人間側の都合になってしまいますが、男女の役割の違いについても対応できるようになり、ロボットが(人間と同じように)私たちの話し相手になれる日も、いずれは来るでしょう。

ところで、AI(人工知能)やロボットの進化の影響として、いずれは私たちの仕事を奪ってしまう、私たちを支配するようになる、といったネガティブなイメージを考えがちですが、ロボットは私たち人間が作り出すものであり、私たち人類全体の考えが反映されるはずです。

遠い将来、ロボットが私たちにとって良き友となっている世界が実現できる方向に、今後の研究が進んでゆくことを信じたいですよね。

コメントをどうぞ

現在一人暮らしの67歳女性です 仕事があるため犬や猫は飼えません(世話できないので) 私には最愛のぬん(カワウソのキャラクターぬいぐるみ)がいます 疲れて帰った時、その愛くるしい姿で疲れが飛びます。携帯の待ち受けはぬん、休憩中はぬんの可愛い写真で癒されています。夜寝るときも抱いて寝ます。たまに返事してくれたらなと思うのですが、このぬいぐるみに人工知能を入れて会話ができるようにならないでしょうか? 以前はベビーカーにぬいぐるみを乗せて散歩している人を見て、驚いていましたが、今はその気持ちが良くわかります。一言でも会話してくれたらと思うのは私だけではないでしょう。クラウドファンディングなどで資金を集めそんな開発ができないものかと考えています。可能性など教えていただければと思います。

コメントありがとうございます。

お問い合わせの件ですが、VAIO株式会社が提供しているサービスにより実現できそうです。

具体的には、VAIO(株)さんが提供する装置(縦7〜8cm・横5〜6cm程度)を、ぬんちゃんに埋め込むことにより、ぬんちゃんと会話できるようになりそうです。

ただし、ぬんちゃんへの埋め込みにあたっては、VAIO(株)さんによるカスタマイズ(それぞれの利用者の必要に応じて装置の各種設定を変更する作業)が必要なようです。

以下のサイトに記載されております、問い合わせ先まで相談されてみてはいかがでしょうか?

●「ロボット汎用プラットフォーム」

ぬいぐるみがそのまま会 話ロボットに! “Simple” ハードウェア

https://vaio.com/ems/pdf/02.pdf